একটি Robots.txt ফাইল কি? এসইও-এর জন্য একটি রোবট ফাইল লিখতে, জমা দিতে এবং পুনরায় ক্রল করতে আপনার যা কিছু দরকার

আমরা একটি ব্যাপক নিবন্ধ লিখেছি কিভাবে সার্চ ইঞ্জিন আপনার ওয়েবসাইট খুঁজে, ক্রল, এবং সূচী. সেই প্রক্রিয়ার একটি মৌলিক পদক্ষেপ হল robots.txt ফাইল, আপনার সাইট ক্রল করার জন্য একটি সার্চ ইঞ্জিনের গেটওয়ে। সার্চ ইঞ্জিন অপ্টিমাইজেশানে একটি robots.txt ফাইল সঠিকভাবে কীভাবে তৈরি করা যায় তা বোঝা অপরিহার্য (এসইও).

এই সহজ কিন্তু শক্তিশালী টুল ওয়েবমাস্টারদের সাহায্য করে কিভাবে সার্চ ইঞ্জিন তাদের ওয়েবসাইটের সাথে ইন্টারঅ্যাক্ট করে। একটি ওয়েবসাইট এর দক্ষ ইন্ডেক্সিং এবং সার্চ ইঞ্জিন ফলাফলে সর্বোত্তম দৃশ্যমানতা নিশ্চিত করার জন্য একটি robots.txt ফাইল বোঝা এবং কার্যকরভাবে ব্যবহার করা অপরিহার্য।

একটি Robots.txt ফাইল কি?

একটি robots.txt ফাইল একটি ওয়েবসাইটের রুট ডিরেক্টরিতে অবস্থিত একটি পাঠ্য ফাইল। এর প্রাথমিক উদ্দেশ্য হল সার্চ ইঞ্জিন ক্রলারদের গাইড করা যে সাইটের কোন অংশগুলি ক্রল করা এবং সূচিত করা উচিত নয়। ফাইলটি রোবট এক্সক্লুশন প্রোটোকল ব্যবহার করে (খ্যাতি), একটি আদর্শ ওয়েবসাইটগুলি ওয়েব ক্রলার এবং অন্যান্য ওয়েব রোবটের সাথে যোগাযোগ করতে ব্যবহার করে।

REP একটি অফিসিয়াল ইন্টারনেট স্ট্যান্ডার্ড নয় কিন্তু বড় সার্চ ইঞ্জিন দ্বারা ব্যাপকভাবে গৃহীত এবং সমর্থিত। একটি স্বীকৃত মানের নিকটতম হল গুগল, বিং এবং ইয়ানডেক্সের মত প্রধান সার্চ ইঞ্জিনের ডকুমেন্টেশন। আরো তথ্যের জন্য, পরিদর্শন Google এর Robots.txt স্পেসিফিকেশন সুপারিশকৃত.

কেন Robots.txt এসইও-এর জন্য গুরুত্বপূর্ণ?

- নিয়ন্ত্রিত ক্রলিং: Robots.txt ওয়েবসাইটের মালিকদের তাদের সাইটের নির্দিষ্ট বিভাগগুলি অ্যাক্সেস করা থেকে সার্চ ইঞ্জিনগুলিকে প্রতিরোধ করার অনুমতি দেয়। ডুপ্লিকেট কন্টেন্ট, ব্যক্তিগত এলাকা বা সংবেদনশীল তথ্য সহ বিভাগগুলি বাদ দেওয়ার জন্য এটি বিশেষভাবে কার্যকর।

- অপ্টিমাইজ করা ক্রল বাজেট: সার্চ ইঞ্জিন প্রতিটি ওয়েবসাইটের জন্য একটি ক্রল বাজেট বরাদ্দ করে, একটি সার্চ ইঞ্জিন বট একটি সাইটে কতগুলি পৃষ্ঠা ক্রল করবে। অপ্রাসঙ্গিক বা কম গুরুত্বপূর্ণ বিভাগগুলিকে অনুমোদন না দিয়ে, robots.txt এই ক্রল বাজেটকে অপ্টিমাইজ করতে সাহায্য করে, যাতে আরও উল্লেখযোগ্য পৃষ্ঠাগুলি ক্রল করা এবং সূচী করা হয়।

- উন্নত ওয়েবসাইট লোডিং সময়: বটগুলিকে গুরুত্বহীন রিসোর্স অ্যাক্সেস করা থেকে আটকানোর মাধ্যমে, robots.txt সার্ভারের লোড কমাতে পারে, সম্ভাব্যভাবে সাইটের লোডিং সময়কে উন্নত করতে পারে, এসইও-তে একটি গুরুত্বপূর্ণ ফ্যাক্টর৷

- অ-পাবলিক পৃষ্ঠাগুলির সূচীকরণ প্রতিরোধ করা: এটি অ-পাবলিক এলাকাগুলিকে (যেমন স্টেজিং সাইট বা ডেভেলপমেন্ট ক্ষেত্রগুলি) সূচীভুক্ত হতে এবং অনুসন্ধানের ফলাফলগুলিতে উপস্থিত হতে সাহায্য করে৷

Robots.txt প্রয়োজনীয় কমান্ড এবং তাদের ব্যবহার

- অনুমতি দিন: সাইটের কোন পৃষ্ঠা বা বিভাগগুলি ক্রলারদের দ্বারা অ্যাক্সেস করা উচিত তা নির্দিষ্ট করতে এই নির্দেশিকাটি ব্যবহার করা হয়৷ উদাহরণস্বরূপ, যদি কোনো ওয়েবসাইটে SEO এর জন্য বিশেষভাবে প্রাসঙ্গিক বিভাগ থাকে, তাহলে 'অনুমতি দিন' কমান্ড এটি ক্রল করা নিশ্চিত করতে পারে।

Allow: /public/- অস্বীকার করুন: 'অনুমতি দিন'-এর বিপরীতে, এই কমান্ডটি সার্চ ইঞ্জিন বটকে নির্দেশ দেয় ওয়েবসাইটের কিছু অংশ ক্রল না করতে। লগইন পৃষ্ঠা বা স্ক্রিপ্ট ফাইলের মতো SEO মান নেই এমন পৃষ্ঠাগুলির জন্য এটি কার্যকর।

Disallow: /private/- ওয়াইল্ডকার্ড: প্যাটার্ন ম্যাচিংয়ের জন্য ওয়াইল্ডকার্ড ব্যবহার করা হয়। তারকাচিহ্ন (*) অক্ষরের যেকোনো ক্রম প্রতিনিধিত্ব করে এবং ডলার চিহ্ন ($) একটি URL এর শেষ নির্দেশ করে। এগুলি ইউআরএলের বিস্তৃত পরিসর নির্দিষ্ট করার জন্য উপযোগী।

Disallow: /*.pdf$- সাইটম্যাপ: robots.txt-এ একটি সাইটম্যাপ অবস্থান সহ সার্চ ইঞ্জিনগুলিকে একটি সাইটের সমস্ত গুরুত্বপূর্ণ পৃষ্ঠাগুলি খুঁজে পেতে এবং ক্রল করতে সহায়তা করে৷ এটি এসইওর জন্য অত্যন্ত গুরুত্বপূর্ণ কারণ এটি একটি সাইটের দ্রুত এবং আরও সম্পূর্ণ সূচীকরণে সহায়তা করে।

Sitemap: https://martech.zone/sitemap_index.xmlRobots.txt অতিরিক্ত কমান্ড এবং তাদের ব্যবহার

- ব্যবহারিক দূত: নিয়মটি কোন ক্রলারে প্রযোজ্য তা উল্লেখ করুন। 'ব্যবহারকারী-এজেন্ট: *' সমস্ত ক্রলারের জন্য নিয়ম প্রযোজ্য। উদাহরণ:

User-agent: Googlebot- Noindex: যদিও স্ট্যান্ডার্ড robots.txt প্রোটোকলের অংশ নয়, কিছু সার্চ ইঞ্জিন বুঝতে পারে a মেটা একটি নির্দেশ হিসাবে robots.txt-এ নির্দেশিত ইউআরএলকে সূচীভুক্ত না করার জন্য।

Noindex: /non-public-page/- ক্রল-বিলম্ব: এই কমান্ডটি ক্রলারদের আপনার সার্ভারে হিট করার মধ্যে একটি নির্দিষ্ট সময় অপেক্ষা করতে বলে, সার্ভার লোড সমস্যাযুক্ত সাইটগুলির জন্য দরকারী।

Crawl-delay: 10কিভাবে আপনার Robots.txt ফাইল পরীক্ষা করবেন

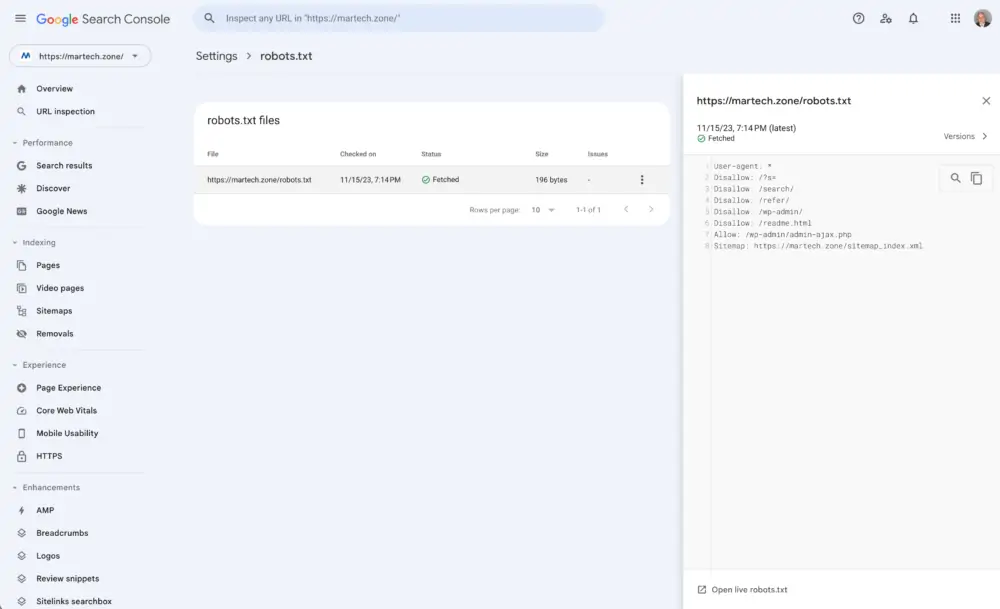

যদিও এটি সমাহিত করা হয়েছে Google অনুসন্ধান কনসোল, অনুসন্ধান কনসোল একটি robots.txt ফাইল পরীক্ষক অফার করে।

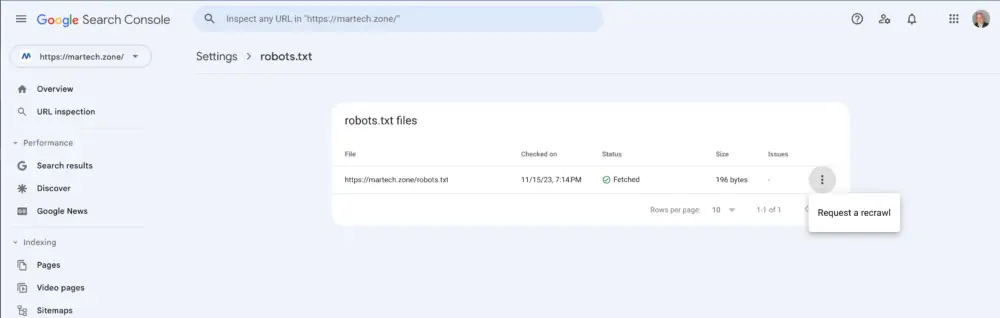

আপনি ডানদিকে তিনটি বিন্দুতে ক্লিক করে এবং নির্বাচন করে আপনার Robots.txt ফাইলটি পুনরায় জমা দিতে পারেন একটি পুনরায় ক্রল অনুরোধ.

আপনার Robots.txt ফাইল পরীক্ষা করুন বা পুনরায় জমা দিন

Robots.txt ফাইল কি এআই বট নিয়ন্ত্রণ করতে ব্যবহার করা যেতে পারে?

robots.txt ফাইলটি ব্যবহার করা যেতে পারে কিনা তা নির্ধারণ করতে AI ওয়েব ক্রলার এবং অন্যান্য স্বয়ংক্রিয় বট সহ বটগুলি আপনার সাইটের সামগ্রী ক্রল বা ব্যবহার করতে পারে৷ ফাইল এই বটগুলিকে নির্দেশ করে, এটি নির্দেশ করে যে ওয়েবসাইটের কোন অংশগুলি অ্যাক্সেস করা থেকে তারা অনুমোদিত বা অননুমোদিত। AI বটগুলির আচরণ নিয়ন্ত্রণ করে robots.txt-এর কার্যকারিতা বিভিন্ন কারণের উপর নির্ভর করে:

- প্রোটোকল মেনে চলা: সর্বাধিক স্বনামধন্য সার্চ ইঞ্জিন ক্রলার এবং অন্যান্য অনেক এআই বট সেট করা নিয়মগুলিকে সম্মান করে

robots.txt. যাইহোক, এটি মনে রাখা গুরুত্বপূর্ণ যে ফাইলটি একটি প্রয়োগযোগ্য বিধিনিষেধের চেয়ে একটি অনুরোধ বেশি৷ বটগুলি এই অনুরোধগুলিকে উপেক্ষা করতে পারে, বিশেষ করে যেগুলি কম বিচক্ষণ সত্তা দ্বারা পরিচালিত হয়৷ - নির্দেশের সুনির্দিষ্টতা: আপনি বিভিন্ন বট জন্য বিভিন্ন নির্দেশাবলী নির্দিষ্ট করতে পারেন. উদাহরণস্বরূপ, আপনি অন্যদের অনুমতি না দেওয়ার সময় নির্দিষ্ট AI বটগুলিকে আপনার সাইট ক্রল করার অনুমতি দিতে পারেন। এটি ব্যবহার করে করা হয়

User-agentমধ্যে নির্দেশrobots.txtউপরের ফাইলের উদাহরণ। উদাহরণ স্বরূপ,User-agent: GooglebotGoogle-এর ক্রলারের জন্য নির্দেশাবলী নির্দিষ্ট করবে, যদিওUser-agent: *সব বট প্রযোজ্য হবে. - সীমাবদ্ধতা: যদিও

robots.txtনির্দিষ্ট বিষয়বস্তু ক্রল থেকে বট প্রতিরোধ করতে পারে; এটা তাদের কাছ থেকে বিষয়বস্তু গোপন করে না যদি তারা ইতিমধ্যেই জানে URL টি. উপরন্তু, এটি একবার ক্রল করার পরে সামগ্রীর ব্যবহার সীমাবদ্ধ করার কোনো উপায় প্রদান করে না। যদি বিষয়বস্তু সুরক্ষা বা নির্দিষ্ট ব্যবহারের বিধিনিষেধের প্রয়োজন হয়, পাসওয়ার্ড সুরক্ষা বা আরও পরিশীলিত অ্যাক্সেস নিয়ন্ত্রণ ব্যবস্থার মতো অন্যান্য পদ্ধতির প্রয়োজন হতে পারে। - বটের প্রকারভেদ: সব এআই বট সার্চ ইঞ্জিনের সাথে সম্পর্কিত নয়। বিভিন্ন বট বিভিন্ন উদ্দেশ্যে ব্যবহার করা হয় (যেমন, ডেটা একত্রীকরণ, বিশ্লেষণ, বিষয়বস্তু স্ক্র্যাপিং)। robots.txt ফাইলটি এই বিভিন্ন ধরণের বটগুলির অ্যাক্সেস পরিচালনা করতেও ব্যবহার করা যেতে পারে, যতক্ষণ না তারা REP মেনে চলে।

সার্জারির robots.txt ফাইলটি এআই বট দ্বারা সাইটের বিষয়বস্তু ক্রলিং এবং ব্যবহার সম্পর্কিত আপনার পছন্দের সংকেত দেওয়ার জন্য একটি কার্যকর হাতিয়ার হতে পারে। যাইহোক, এর ক্ষমতা কঠোর অ্যাক্সেস নিয়ন্ত্রণ প্রয়োগ করার পরিবর্তে নির্দেশিকা প্রদানের মধ্যে সীমাবদ্ধ, এবং এর কার্যকারিতা রোবটস এক্সক্লুশন প্রোটোকলের সাথে বটগুলির সম্মতির উপর নির্ভর করে।

robots.txt ফাইলটি এসইও অস্ত্রাগারের একটি ছোট কিন্তু শক্তিশালী টুল। সঠিকভাবে ব্যবহার করা হলে এটি একটি ওয়েবসাইটের দৃশ্যমানতা এবং সার্চ ইঞ্জিন কর্মক্ষমতাকে উল্লেখযোগ্যভাবে প্রভাবিত করতে পারে। একটি সাইটের কোন অংশগুলি ক্রল করা এবং সূচীকরণ করা হয় তা নিয়ন্ত্রণ করে, ওয়েবমাস্টাররা নিশ্চিত করতে পারে যে তাদের সবচেয়ে মূল্যবান বিষয়বস্তু হাইলাইট করা হয়েছে, তাদের এসইও প্রচেষ্টা এবং ওয়েবসাইট কর্মক্ষমতা উন্নত করে।